¿Qué es un crawler o arañas de la web y qué hacen?

¿Sabes lo que es un crawler? ¿Has escuchado hablar alguna vez de las arañas en la web? ¡Te explicamos qué son y cuál es el papel que juegan en el funcionamiento de los motores de búsqueda!

¿Qué es un crawler?

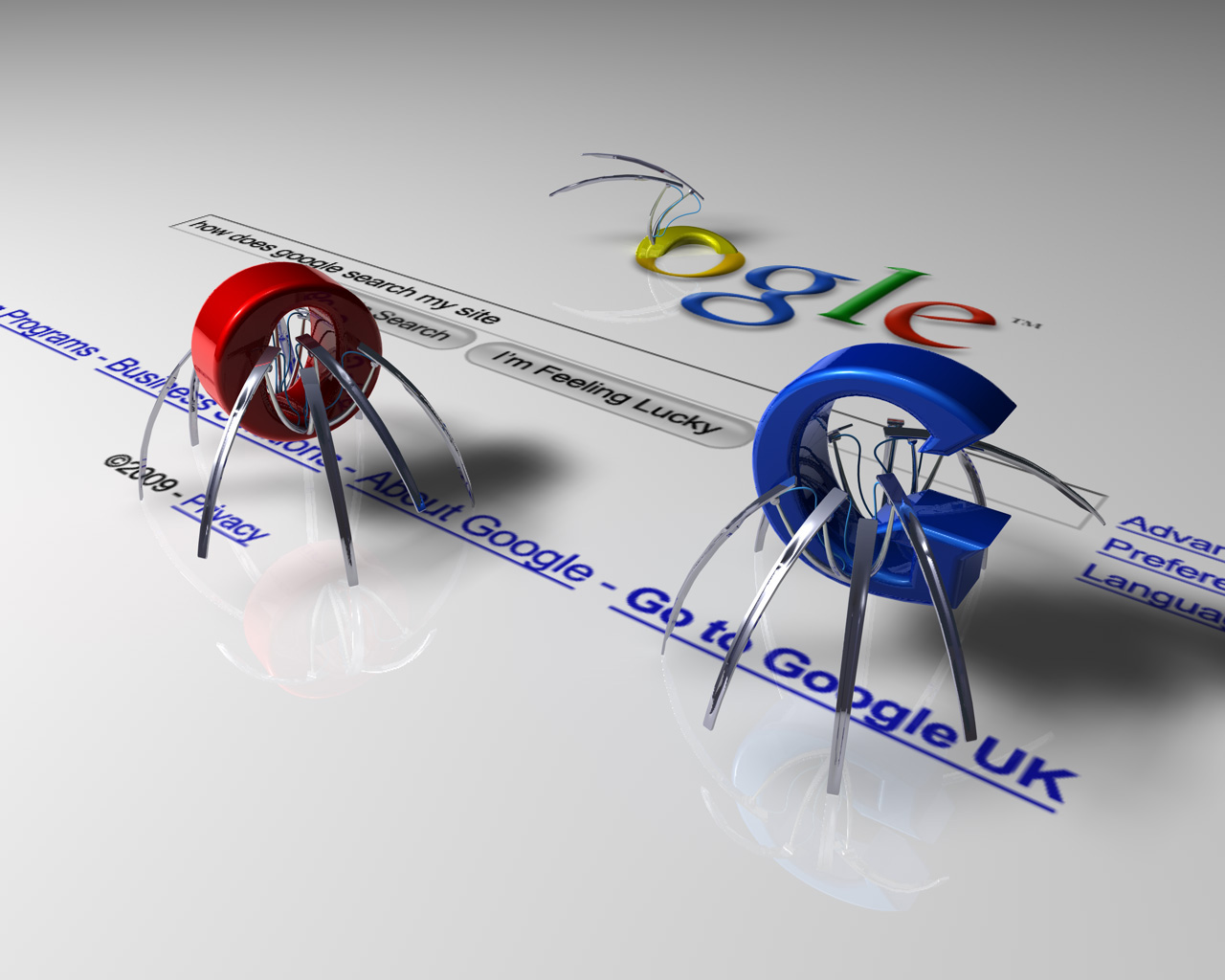

El crawler, también conocido como araña de la web, es un software o webbot que se encarga de recorrer los enlaces de las páginas webs de una forma automática y sistemática.

¿Qué hace un crawler y cómo funciona?

Normalmente, un crawler dispone de un conjunto inicial de URLs, conocidas como semillas, y va descargando las páginas Web asociadas a las semillas y buscando dentro de éstas otras URLs.

Cada nueva URL encontrada se añade a la lista de URLs que la araña Web debe visitar. Es decir, recoleta URL’s para posteriormente procesarlas. Así, el motor de búsqueda creará un índice de las páginas descargadas para proporcionar búsquedas más rápidas.

Cuando un crawler visita un sitio web opta por una de estas dos alternativas:

- Buscar el archivo robots.txt y la meta etiqueta robots para ver las reglas que se han estipulado.

- Elaborar un índice de las páginas web que hay en su sitio. ¿Cómo? Explorando el contenido del texto visible, de varias etiquetas HTML y los hipervínculos en listados en la página.

Googlebot

El crawler más famoso del mundo es Googlebot, el software diseñado por Google para indexar el contenido nuevo o actualizado de Internet.

Una vez el contenido está indexado, el servidor lo clasifica y establece un orden de relevancia para las distintas búsquedas que pueda efectuar un usuario, es decir, lo posiciona.

De manera que, el primer paso necesario, para poder empezar a competir por figurar entre las primeras posiciones del buscador, es que la página web sea indexada por el crawler. Para ello, podemos mandar directamente nuestra URL a Google para que sepa que debe visitarla.

La frecuencia con la que Googlebot accede a un sitio web depende del PageRank de éste, debido a que cuanto mayor sea este valor, el robot accederá más reiteradamente a sus páginas. En este sentido, los medios de comunicación son visitados cada día por Googlebot, mientas que hay sites a los que no accede en semanas.

Para saber si Googlebot ha visitado a nuestra página, sólo tenemos que revisar el cache y observar los log de nuestro servidor para ver si el rastreador se ha presentado.

En último lugar, hay que tener en cuenta, que el crawler es un robot y sólo lee el código fuente de la página web que esté rastreando, no el diseño ni las imágenes o el contenido en Flash, por esto, debemos tener una página web optimizada para este robot, ya que de lo contrario no nos prestará atención y no podremos posicionarnos.